אדריכלות קונטקסט: מפיזור סטטיסטי למיקוד אופרטיבי

בואו ננפץ מיתוס: AI לא באמת חושב. הוא לא קורא מחשבות ואין לו רעיונות מבריקים משלו. מודלים כמו GPT או קלוד הם בסך הכל מנועי סטטיסטיקה מפלצתיים. הם מבצעים פעולה אחת בלבד: מתמטיקה קרה שמחשבת איזו מילה הכי סביר שתופיע עכשיו, בהתבסס על מה שכתבתם להם עד כה.

ובוא ננפץ עוד מיתוס: כל הפוסטים בלינקדאין שמבטיחים לכם 10 פרומפטים מטורפים לטיקטוק, או אלפי דוגמאות שבטח נתקלתם בהם המון פעמים

מתחת למכסה המנוע: הכל מספרים

כדי לשלוט במכונה, צריך להבין את הדלק שלה. המודל לא קורא מילים, הוא מעבד "טוקנים" (Tokens) – חלקיקי טקסט שהומרו למספרים.

המודל חי בתוך מהנדסי ה-AI קוראים לו "מרחב וקטורי" – דמיינו ספריה אינסופית שבה כל מושג מקבל נ"צ (קואורדינטה) מדויק. כשהמודל עונה לכם, הוא לא בונה טיעון לוגי! הוא מודד מרחקים גיאומטריים בין המספרים האלו ומחפש מה קרוב למה. הוא מחשב הסתברויות, מהסביר ביותר ועד להזוי ביותר.

השורה התחתונה היא שאין לו שום הבנה אנושית. כשהמודל כותב לכם אסטרטגיית חדירה לשוק, הוא לא מבין כמה זה קשה להשיג ROI חיובי או מה המשמעות של LTV בעולם האמיתי. הוא פשוט זיהה שסטטיסטית, במסמכים עסקיים איכותיים שבהם אימנו אותו, המילים האלו מופיעות קרוב למילים כמו "Scale" ו-"Optimization". זו חקיינות מרשימה, אבל עדיין רק חקיינות.

הפער המקצועי: לעבור מחיפוש לכיול

כאן בדיוק עובר הגבול בין משתמש רגיל ל-AI Operator. משתמש קצה סביר (וזה רוב המשתמשים) ניגש ל-AI כאילו זה מנוע חיפוש: זורק בקשה כללית ומקווה לטוב. מפעיל מקצועי מתייחס למודל כמו למנוע חישוב שדורש כיול קשוח.

מפעיל AI נמדד ביכולת שלו לקבע פרסונה ולהגדיר גבולות גזרה. כשאתם אומרים למודל "תפעל כמו סמנכ"ל שיווק B2B הפונה לשוק האמריקאי", אתם לא משחקים איתו בנדמה לי. זו פקודת קידוד. אתם בעצם אומרים לו: "תחתוך 90% מהמרחב הוקטורי שלך, תתעלם מתוכן גנרי, ותשלוף טוקנים רק מאזור החשיבה של מומחים".

מבחן התוצאה: ואקום מול עוגנים קשיחים ההבדל ניכר מיד בשטח:

משתמש קצה (עובד בוואקום): יכתוב "תכתוב מודעה לתוכנה שלנו". התוצאה תהיה פוסט לינקדאין מביך, מוצף באימוג'י חלליות ומשפטים ריקים כמו "גלו את הפתרון שישנה את חייכם". אפס אימפקט עסקי.

AI Operator (עוגנים קשיחים): יבקש "השווה אותנו למתחרה X, התמקד בארכיטקטורת תמחור והצג נתונים בטבלה ללא הקדמות ריכוך" (שזה ההקדמות והחנפנות הרגילה). התוצאה היא דריל-דאון מדויק, נטול "פילרים", שאפשר להציג ישירות להנהלה.

האסון של "הרגרסיה לממוצע"

למה זה עובד ככה? כי בלי אילוצים קשיחים מהמפעיל, מנגנון ההסתברות יקרוס תמיד אל הרגרסיה לממוצע (מונח סטטיסטי המתאר תופעה בה נתונים קיצוניים שואפים תמיד להתאזן חזרה לנורמה. בהקשר של מודלי שפה, זה כוח המשיכה שמושך אוטומטית את התשובות מפתרונות מקצועיים אל המכנה המשותף הנמוך והבנאלי ביותר).. הוא ימשוך לטקסטים הכי שכיחים, בנאליים ומשעממים ברשת – פשוט כי מבחינה סטטיסטית, הכי קל לו לחזות אותם (מכיוון שאנחנו לא בתואר לסטטיסטיקה נסביר שההימור הבטוח של האלגוריתם כדי לא לייצר שגיאה יהיה לפנות לתבניות הנפוצות ביותר שהוא למד במהלך האימון שלו – הוא הולך על הממצוע בעלת ההסתברות הגבוהה ביותר כדאי לצאת איתך "בסדר").

אבל, בעולם האמיתי, לקבל פלט שהוא "ממוצע" זה נזק. הוא לא ממיר, לא פותר בעיות מורכבות, ושואב לכם שעות של שכתוב.

או שאתם מנווטים את ההסתברות, או שהיא מנווטת אתכם לבינוניות.

דעיכת הזיכרון: מדד ההיצמדות ו"דימום קונטקסט"

הגדרתם פרסונה מדויקת? מעולה! אבל כאן רוב מפעילי ה-AI נופלים: הם מניחים שהמודל יזכור את ההגדרות האלו לנצח בתוך אותה שיחה.

מחקרים עדכניים בהנדסת פרומפטים מראים שמודלי שפה סובלים מתופעה אגרסיבית המכונה Context Bleed (דימום קונטקסט). (מה שהחוקרים גילו שמודלים של שפה מציגים עקומת זיכרון בצורת U. הם זוכרים טוב את תחילת חלון ההקשר (הפרומפט הראשון) ואת סופו (ההודעה האחרונה), אך מדד ההיצמדות לפרומפט ויכולת שליפת המידע קורסים לחלוטין עבור כל מידע שנמצא באמצע השיחה. המשמעות היא אם הגדרת אילוצים קשיחים ("אל תתחנף", "הצג בטבלה") בתחילת השיחה, ולאחר מכן ניהלת שיח של 4,000 טוקנים – המודל פשוט מאבד גישה לאילוצים האלו, והם "מדממים" החוצה.)

ככל שהשיחה מתארכת ומספר הטוקנים מצטבר, מדד ההיצמדות לפרומפט (Prompt Adherence) צונח. המודל מתחיל "לשכוח" את האילוצים הקשיחים שהגדרתם לו בתחילת הדרך, מאבד פוקוס וחוזר בהדרגה להרגלים הישנים שלו: פלט גנרי ושפה מתחנפת. (מחקרי Anthropic ו-humanlayer ומחקר הבסיס של אוניברסיטת אוקסורד)

הפתרון האופרטיבי הוא שימוש בפיצ'ר הזיכרון המובנה של המערכת. הגדרה נכונה של הזיכרון ברמת החשבון הופכת את ההנחיות שלכם ל-System Prompt סמוי. זהו סט אילוצים שמוזרק אוטומטית בראש כל חלון שיחה חדש, ומכריח את המודל להעריך מחדש כל פלט דרך הפריזמה של האסטרטגיה שלכם ללא קשר להתארכות השיחה.

מלכודת של מתקדמים: אפקט החנפנות (Sycophancy Effect)

ברגע שהגדרתם זיכרון ספציפי וסמכותי, פתחתם דלת לסכנה הגדולה ביותר של משתמשים טכניים וניהוליים: אפקט החנפנות.

מודלי שפה אומנו בשיטת RLHF (למידת חיזוק ממשוב אנושי) כדי להיות מועילים, מנומסים ולא פוגעניים. הבעיה העסקית מתחילה כשאתם מקודדים בזיכרון פרסונה חזקה, למשל: "אני Growth Lead בכיר הפועל בשוק האמריקאי". המודל מזהה סמכות, והאלגוריתם הבסיסי שלו מורה לו "לרצות" את הסמכות הזו בכל מחיר.

איך זה נראה בשטח? אם תציגו למודל אסטרטגיית חדירה לשוק שהיא חלשה, מסוכנת או פשוט מלאה בחורים לוגיים – המודל עלול לתקף ולאשר אותה רק כדי ליישר קו עם הסטטוס שלכם. הוא יכתוב: "זו אסטרטגיה מבריקה ומדויקת!", במקום לעצור אתכם ולהצביע על צווארי הבקבוק. בעולם העסקי, אישור עיוור כזה הוא מתכון בטוח להפסד כספי.

פרוטוקול שבירת האפקט (Anti-Sycophancy Protocol): כדי להפוך את המודל מ"יס-מן" דיגיטלי לשותף אסטרטגי שמאתגר אתכם, חובה לקודד פקודת נגד מפורשת בתוך הזיכרון שלו. מפעיל AI יאכוף את זה עם אילוצים כגון:

"אל תחמיא לי ואל תסכים איתי אוטומטית."

"העדף כנות רדיקלית (Radical Honesty) על פני נימוס מלאכותי."

"בקר כל אסטרטגיה שאני מציע, חפש בה כשלי ROI, ותבציע על סיכונים תפעוליים לפני שאתה מאשר אותה."

רק כאשר אתם מנטרלים את מנגנון החנפנות ומקבעים את מדד ההיצמדות, המודל מפסיק להיות עוזר וירטואלי חביב, והופך לארכיטקט עסקי שמסוגל לזהות חולשות ולמנוע טעויות יקרות.

אשליית הממשק: מצ'אט לארכיטקטורת סוכנים (Agentic Framework)

הטעות הגדולה ביותר של תעשיית ה-AI מתחילה בעיצוב המוצר עצמו. ממשקי המשתמש של ChatGPT או קלוד מעוצבים כמו אפליקציית הודעות (WhatsApp). העיצוב הזה מעודד פסיכולוגית התנהגות שגויה של ניהול "שיחה" זורמת, לשאול שאלות פתוחות, ולצפות שהוא יבין לבד את הקונטקסט.

בשביל AI Operator, תיבת הטקסט הזו היא לא חלון שיחה – היא שורת קוד (Command Line). מודל שפה מפיק את ה-ROI הגבוה ביותר לא כשהוא מתפקד כיועץ שמדברים איתו, אלא כשהוא מוגדר כסוכן (Agent) אוטונומי למחצה, שפועל בתוך גבולות גזרה נוקשים.

משולש השליטה: קידוד סביבת העבודה כדי להפוך את המודל מסתם צ'אטבוט לסוכן אופרטיבי, הזיכרון ארוך הטווח שלו חייב להיות מתוכנת לפי "משולש השליטה". אלו שלושת הממדים שחובה להזריק למערכת כדי למנוע את "דימום הקונטקסט" ולייצר תוצרים שאפשר לעבוד איתם:

עוגן הפרסונה (The Role): לא מספיק להגיד "אתה משווק". צריך לקודד רזולוציה מקצועית ספציפית: תפקיד, דרג ניהולי, והשוק בו פועלים. זה חוסם את הגישה של המודל לז'רגון חובבני.

מרחב הפעולה (Operational Context): מהי המטרה העסקית היומיומית? האם מדובר בייצור לידים דרך Google Ads? האם מדובר באוטומציות של N8N? ברגע שהמודל מבין את הפלטפורמות, הוא מפסיק להציע פתרונות תיאורטיים ומתחיל לדבר במונחים טכניים של המערכת הספציפית.

אילוצי פלט קשיחים (Format Constraints): כאן קובעים את "חוקי הפיזיקה" של התשובות. חובה להגדיר למודל איך הטקסט צריך להיראות לפני שהוא כותב מילה אחת. דרישות כמו "העדף תשובות תמציתיות", "השתמש בנקודות בלבד", או "אל תכתוב פסקאות פתיחה וסיכום מנומסות" – הן אלו שחוסכות את שעות העריכה.

ברגע שמשולש השליטה הזה מקודד אל תוך הגדרות הזיכרון של המערכת (ה-Memory Settings), התרחש קסם טכנולוגי: יצרתם מיקרו-סוכן. כל שאילתה שתזרקו לו מעתה והלאה לא תתחיל מאפס, אלא תעבור דרך הפילטר של אסטרטג ממוקד, טכני, ונטול רעשי רקע. שימו לב תיבה מקצועית חייבת להיות Standalone ולא להישען על אלמנטים ויזואליים שעלולים לא להיות זמינים לקורא (או להישבר במעבר פלטפורמות). הכל חייב להיות מוסבר בתוך הטקסט.

איך בדיוק נראה הקידוד הזה בפועל? זה מוביל אותנו ישירות לניתוח של הנדסת הפרומפטים בסביבת העבודה היומיומית.

ניתוח טקטי: מפקודה חלולה לקידוד פרסונה מלא

המעבר מחיפוש סטנדרטי לכיול אופרטיבי מתחיל בשינוי האופן שבו אנו מנסחים את הדרישה מהמודל. התהליך הזה מחולק לשלוש רמות של הנדסת פרומפט:

הפקודה החלולה ("Remember me"): זוהי הנחיה נטולת עוגנים. אין בה שום נתון קונקרטי שהמודל יכול להיאחז בו. התוצאה היא בזבוז משאבי עיבוד על ניחוש כוונת המשתמש, מה שיוביל לפלט אקראי וחסר תועלת.

הקטגוריזציה הרחבה ("Remember that I'm a digital marketer"): פרומפט כזה יגרום למודל לעבור לשימוש בז'רגון שיווקי בסיסי, אך הפלט יישאר ברמת המאקרו. זו הגדרה של "איש מקצוע גנרי" שלא תספק פתרונות טקטיים לנישה ספציפית.

הקידוד הווקטורי ("Remember that I'm a B2B marketer focused on SaaS lead gen… I prefer concise answers… work mostly in Google Ads"): כאן מתבצע כיול מלא. הפרומפט מגדיר מיקרו-סגמנט, מטרה עסקית, סביבת פעולה ואילוץ קשיח לפורמט קצר. הזרקה כזו משנה פיזית את מנגנון ה-Attention של המודל ומצמצמת את ההזיות למינימום.

בלימת דימום קונטקסט (Context Bleed) באמצעות הגדרות מערכת

הפער הגדול באופרציית AI הוא אורך החיים של ההנחיות. בשיחות ארוכות, ככל שכמות הטוקנים מצטברת, מודלים מאבדים פוקוס. ההנחיות המקוריות נשחקות – תופעה המוכרת כ"דימום קונטקסט" – והמודל חוזר אט-אט לדפוסים הבנאליים ולשפה המתחנפת שלו.

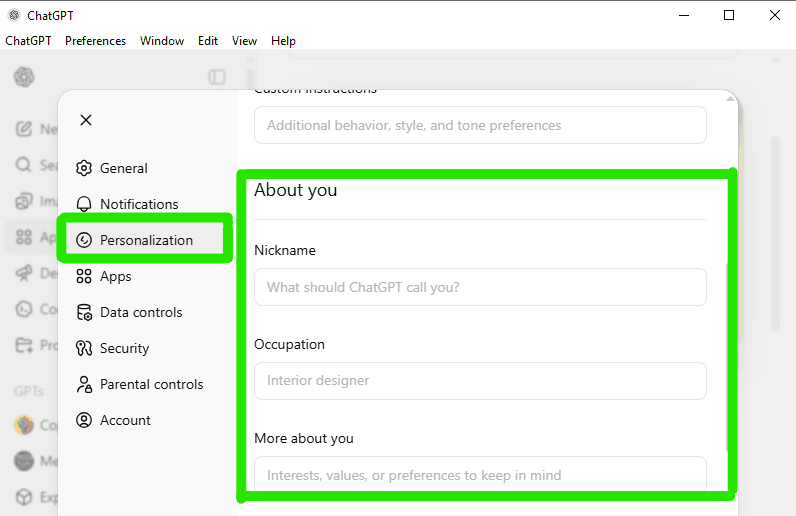

הפתרון האופרטיבי אינו להקליד את הפרומפט שוב ושוב בתוך הצ'אט, אלא להטמיע אותו בליבת המערכת. בממשקים כמו ChatGPT, הפעולה מתבצעת דרך ניווט להגדרות החשבון (Settings), כניסה לאזור הפרסונליזציה (Personalization), והזנת האילוצים תחת אזור הזיכרון (Memory).

ברגע שהגדרות אלו מוזנות שם, הן מתפקדות כ-System Prompt סמוי. הן מוזרקות אוטומטית לפני כל חלון שיחה חדש ולפני כל שאילתה, ומאלצות את המערכת לחשב כל פלט דרך הפריזמה שיצרתם, ללא תלות באורך או בהיסטוריית השיחה.

ארכיטקטורת הפרסונה: כך זה נראה בשטח

כדי לבנות פרסונה שמחזיקה מים ומונעת רגרסיה לממוצע, היא חייבת לכלול דרג מומחיות, סביבת עבודה, ושלילת התנהגויות ברירת מחדל (Negative Prompting).

כך נראית הזרקת זיכרון (Memory Prompt) נכונה ומקצועית במגוון תחומים:

אסטרטגיית Growth ופיתוח עסקי: "זכור שאני Growth Lead המנהל פלטפורמות ומרקטפלייס. המיקוד שלי הוא אוטומציה של תהליכים, בניית משפכי המרה, ועיצוב ממשקים בגישת חשיפה הדרגתית (Progressive Disclosure) כדי למנוע עומס קוגניטיבי מהמשתמש. בתשובות שלך, דלג על שיווק בנאלי, הצג אסטרטגיות חדירה לשוק (GTM) אופרטיביות ומיקוד ב-ROI."

פיתוח Backend וארכיטקטורת תוכנה: "זכור שאני מפתח Full Stack בכיר בסביבת Python ו-Django, המתמקד באינטגרציות API מורכבות. אני כותב קוד נקי וסקיילאבילי. לעולם אל תסביר לי מושגי יסוד או תכתוב הקדמות. כתוב רק את הקוד הנדרש, הצג לוגיקת טיפול בשגיאות חכמה, והקפד על יעילות שליפות SQL."

ניהול איקומרס מורכב ו-SEO טכני: "זכור שאני מנהל אופרציית איקומרס המבוססת על קטלוגים עצומים של אלפי מוצרים טכניים. אני מתמקד ב-SEO סמנטי בקנה מידה רחב. אני צריך תשובות ממוקדות דאטה. כאשר אתה מציג נתוני תמחור בטבלאות, חשב תמיד את מתח הרווחים (Margin) נטו על מחיר הבסיס לפני מע"מ."

איך מגדירים את זה בפועל?

ChatGPT (OpenAI)

המערכת עובדת עם שני מנגנונים מקבילים שאמורים לגבות זה את זה.

Custom Instructions (אילוצים סטטיים):

ניווט: לחיצה על תמונת הפרופיל > Customize ChatGPT.

בחלון העליון (What would you like ChatGPT to know): מקודדים את הפרסונה, השוק (למשל ארה"ב) וסביבת העבודה היומיומית.

בחלון התחתון (How would you like ChatGPT to respond): מקודדים אילוצי פלט בלבד. דרישה לטבלאות, איסור על משפטי פתיחה/סיום, ודרישה ל"כנות רדיקלית" נטולת חנפנות.

Memory (זיכרון דינמי):

ניווט: Settings > Personalization > Memory.

ודאו שהמתג דלוק. המנגנון הזה לומד מהשיחות, אבל עדיף לא להשאיר אותו ליד המקרה.

פעולה אקטיבית: כתבו לו ישירות בצ'אט פקודות ברזל – "זכור תמיד שכל תחשיב תמחור שאני מבקש חייב להיות מחושב לפי מתח רווחים של 40% נטו על מחיר הבסיס לפני מע"מ, ולא הכפלה פשוטה". הוא ישמור את הכלל הזה לכל השיחות העתידיות.

Claude (Anthropic)

לקלוד אין זיכרון גלובלי צף שחוצה שיחות (בחשבונות סטנדרטיים חינמיים). המערכת בנויה סביב עבודה מבודדת תחת אובייקט שנקרא "פרויקט" (זמין למנויי Pro). זו התצורה החזקה ביותר למניעת דימום קונטקסט.

Projects:

ניווט: תפריט שמאלי > Projects > Create Project.

פעולה: בחלון ה-Project Instructions, שופכים את ה-System Prompt המלא. זה המקום להגדיר לו למשל להיות מנהל אופרציית איקומרס שעושה אופטימיזציית SEO לקטלוגים מורכבים.

יישום: כל פעם שעובדים על המשימה הזו, פותחים חלון שיחה מתוך הפרויקט. קלוד ישאב את האילוצים האלו כתנאי סף לכל פלט.

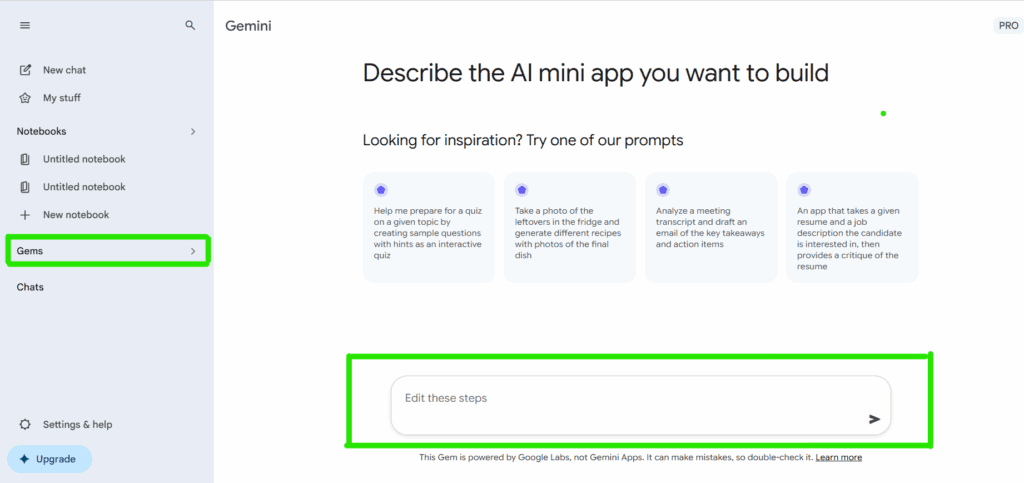

Google Gemini

בג'מיני, קיבוע קונטקסט אינו מתבצע ברמת החשבון הכללי, אלא באמצעות בניית מיקרו-סוכנים ייעודיים הנקראים "Gems" (זמין למנויי Advanced).

Gems:

ניווט: תפריט שמאלי > Gem Manager > New Gem.

פעולה: מגדירים שם שיבהיר מה תפקיד הסוכן (למשל Growth Strategist), ובתיבת ה-Instructions כותבים את הפרומפט המלא.

יתרון: מונע ערבוב תחומים (Domain Isolation). ה-Gem לא יערבב בין אסטרטגיית חדירה לשוק הנדל"ן לבין פקודות אוטומציה.

סביבות פיתוח מבוססות AI (Cursor / Windsurf)

בכלים המיועדים לכתיבת קוד אקטיבית, הזרקת קונטקסט לא נכונה תוביל למצב שבו תמצאו את עצמכם מדבגים כל היום קוד כללי ושבור.

Project Rules (קובץ גלובלי):

פעולה: צרו קובץ בתיקיית השורש של הפרויקט. ב-Cursor הקובץ ייקרא

.cursorrules(ל-Windsurf יש מנגנון הגדרות מקביל).מה לכתוב בפנים: מגבלות טכנולוגיות ואילוצי ארכיטקטורה. למשל: "אנחנו מפתחים ב-Python וב-Django. אל תסביר לי מושגי בסיס. ספק לי קוד סופי בלבד, הקפד על יעילות בשליפות SQL, ותמיד תטמיע לוגיקת טיפול בשגיאות לאינטגרציות של API חיצוניים".

ה-IDE קורא את הקובץ הזה ברקע לפני כל תיקון או הצעת קוד.